Was versteht man unter einem Crawler?

Ein Crawler ist ein Softwareprogramm, das eigenständig alle Webseiten bzw. Dokumente im Internet durchsucht. Da die Suche nach neuen Inhalten automatisiert abläuft, werden sie oft auch als Robots bezeichnet. Der bekannteste Robot bzw. Crawler ist der Googlebot.

Crawler werden von Suchmaschinen eingesetzt, um deren Index zu ergänzen und zu aktualisieren. Sie sind damit wesentlicher Bestandteil einer jeden Suchmaschine und ermöglichen es erst, dass Webseiten überhaupt in den Suchergebnissen ranken können.

Darüber hinaus ähnelt der Weg, den die Crawler im Internet zurücklegen, einem Spinnennetz. Deswegen bezeichnet man Crawler manchmal auch als Spider.

Funktionsweise von Crawlern

Suchmaschinencrawler scannen das Internet immer wieder nach neuen Webseiten und Inhalten. Dafür hangeln sie sich beim Besuch jeder Website von Link zu Link und durchforsten so alle dahinterliegenden Inhalte. Dies betrifft sowohl eingehende, als auch ausgehende Links einer Seite.

Angenommen, eine Website wäre von allen anderen Seiten im Internet vollständig isoliert, würde also weder eingehende, noch ausgehende Links enthalten (Orphan Page). In diesem Fall wäre der Crawler nicht in der Lage, die Seite zu besuchen, da ihm schlichtweg die „Tür“ zu den Inhalten fehlt.

Alle Inhalte, die der Crawler auf seiner Reise durch das Internet findet, sendet er an den Suchmaschinenindex. Dort werden die Inhalte ausgewertet und kategorisiert. Sobald ein Nutzer eine Suchanfrage über Google startet, werden die Webseiten im Index mit den Begriffen der Suchanfrage verglichen und entsprechend ihrer Relevanz in eine aufsteigende Reihenfolge gebracht. So entsteht schließlich das Suchmaschinenranking. Über 200 Kriterien spielen bei der Bewertung der Relevanz einer Website mittlerweile eine Rolle.

Wie oft wird eine Website gecrawlt?

Sobald ein Crawler eine neue Website das erste Mal entdeckt, wird er anschließend immer öfter zurück kehren um nachzuschauen, ob sich etwas verändert hat. Falls er auf neue Inhalte stößt, wird der Index entsprechend aktualisiert.

Je öfter eine Seite aktualisiert wird, desto häufiger schaut auch der Crawler vorbei. So sehen wir beispielsweise bei großen und vertrauenswürdigen Zeitungen immer aktuelle News bereits wenige Minuten nach der Veröffentlichung bei Google.

Stellt der Crawler hingegen fest, dass eine Website über einen langen Zeitraum keine Aktualisierungen oder neuen Inhalte hinzufügt, dann wird er auch immer seltener vorbeischauen.

Das Crawl Budget

Für jede Seite, die der Robot besucht, steht ihm nur ein begrenzter Zeitraum zur Verfügung, das Crawl Budget. Der Bot liest den Quellcode einer Seite von oben nach unten. Deswegen ist beispielsweise ein schlanker Quellcode wichtig. Denn wenn bereits im Kopfbereich des Quellcodes viele überflüssige Informationen liegen oder zu viele externe Daten geladen werden müssen, wird schon allein an dieser Stelle ein großer Teil des Crawl Budgets verbraucht. Zwar ist das sehr selten, dennoch kann es theoretisch passieren, dass das Crawl Budget durch sowas bereits verbraucht ist, bevor der Crawler überhaupt Zeit hatte, die relevanten Inhalte einer Seite auszulesen.

Auch eine klare Webseitenstruktur und eine insgesamt niedrige Dateigröße können wesentlich dazu beitragen, dass kein unnötiges Crawl Budget verbraucht wird.

Crawlern den Besuch einer Seite verbieten

Manchmal kann es sinnvoll sein, einem Crawler den Besuch bestimmter Seiten zu verbieten. Dies können beispielsweise Admin-Seiten sein.

Mithilfe der sogenannten Robots Datei kann man Crawler auf der eigenen Website steuern. So kann man ihnen beispielsweise verbieten, bestimmte Seiten zu durchsuchen. Diese werden dann natürlich nicht in den Index aufgenommen und erscheinen somit auch nicht in den Suchergebnissen.

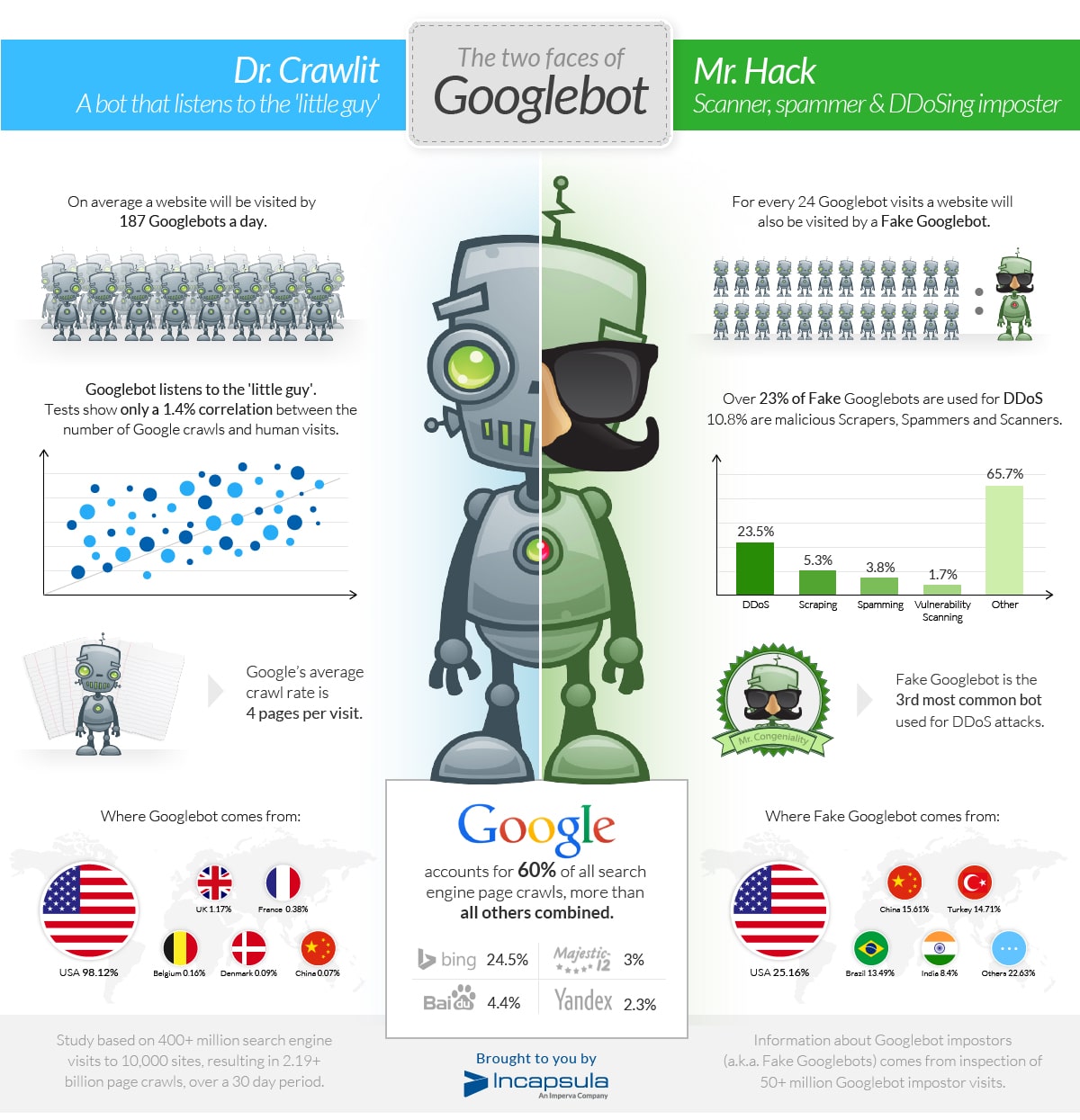

Hierzu noch eine interessante Infografik zum Googlebot von Imperva:

Wie hilfreich war dieser Beitrag?

Klicke auf die Sterne um zu bewerten!

Durchschnittliche Bewertung / 5. Anzahl Bewertungen:

Bisher keine Bewertungen! Sei der Erste, der diesen Beitrag bewertet.

Es tut uns leid, dass der Beitrag für dich nicht hilfreich war!

Lasse uns diesen Beitrag verbessern!

Wie können wir diesen Beitrag verbessern?